Cześć,

potrzebuję wsparcia. Chciałbym "przeorganizować" mój serwer NAS.

Posiadam QNAP TVS-474h z QuTS hero!

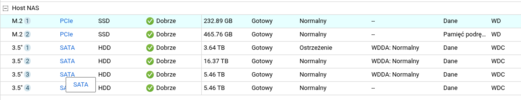

Mam w nim zainstalowane następujące dyski:

1. SSD 256GB - "System" - foldery udostępnione/systemowe, zainstalowane są również na nim aplikacje systemowe QNAP - Pula 1

2. SSD 512GB - pamięć podręczna

3. 4 dyski HDD - DANE - pule od 2 do 5

Chciałbym bezpiecznie zamienić rolami dyski SSD 1 i 2.

Z dysku SSD 512GB - chiałbym zrobić dysk "Systemowy" i tam przenieść aplikacje oraz foldery systemowe (np.: Container, homes, Multimedia, Public, Virtual Machines, Web, itp.) z dysku SSD 256GB

Z dysku SSD 256GB - chciałbym zrobić pamieć podręczną.

Ktoś podpowie czy możliwe jest zrobienie tego bezpiecznie żeby system nie padł i po zmianach działał prawidłowo/stabilnie? Jak to bezpiecznie, zgodnie ze sztuką zrobić aby nie rozwalić systemu?

Powodem tej zamiany jest to, że dysk SSD 1 (256GB) się całkowicie zapchał!!! Wydaje mi się, że Container Station (6 kontenerów - n8n, ollama, qdrant, postgres, gramps, gramps-mcp) zeżarł mi ze 170 GB!

Próbowałem też ustalić z AI jak odchudzić ten dysk. ale zaproponował usunięcie wszystkich kontenerów i nową instalację (podobno snapschoty Container wszystko zapchały) - odpuściłem

potrzebuję wsparcia. Chciałbym "przeorganizować" mój serwer NAS.

Posiadam QNAP TVS-474h z QuTS hero!

Mam w nim zainstalowane następujące dyski:

1. SSD 256GB - "System" - foldery udostępnione/systemowe, zainstalowane są również na nim aplikacje systemowe QNAP - Pula 1

2. SSD 512GB - pamięć podręczna

3. 4 dyski HDD - DANE - pule od 2 do 5

Chciałbym bezpiecznie zamienić rolami dyski SSD 1 i 2.

Z dysku SSD 512GB - chiałbym zrobić dysk "Systemowy" i tam przenieść aplikacje oraz foldery systemowe (np.: Container, homes, Multimedia, Public, Virtual Machines, Web, itp.) z dysku SSD 256GB

Z dysku SSD 256GB - chciałbym zrobić pamieć podręczną.

Ktoś podpowie czy możliwe jest zrobienie tego bezpiecznie żeby system nie padł i po zmianach działał prawidłowo/stabilnie? Jak to bezpiecznie, zgodnie ze sztuką zrobić aby nie rozwalić systemu?

Powodem tej zamiany jest to, że dysk SSD 1 (256GB) się całkowicie zapchał!!! Wydaje mi się, że Container Station (6 kontenerów - n8n, ollama, qdrant, postgres, gramps, gramps-mcp) zeżarł mi ze 170 GB!

Próbowałem też ustalić z AI jak odchudzić ten dysk. ale zaproponował usunięcie wszystkich kontenerów i nową instalację (podobno snapschoty Container wszystko zapchały) - odpuściłem